Durante las últimas décadas, gran parte del esfuerzo en la investigación de la IA se ha centrado en el desarrollo de arquitecturas neuronales más potentes y algoritmos de optimización para su entrenamiento efectivo. Sin embargo, a pesar de los avances significativos, especialmente en los Grandes Modelos de Lenguaje (LLMs), persisten desafíos fundamentales en torno a la capacidad de estos modelos para aprender continuamente, memorizar, auto-mejorarse y encontrar «soluciones efectivas».

Los LLMs a menudo son estáticos después de su implementación inicial, limitando su capacidad para adquirir nuevas capacidades más allá de su contexto inmediato. Su conocimiento se restringe al contexto que cabe en la ventana o al conocimiento almacenado en las capas MLP durante el pre-entrenamiento. Esto ha llevado a cuestionar si se necesita un nuevo paradigma de aprendizaje más allá del simple apilamiento de capas.

¿Qué es el Aprendizaje Anidado (Nested Learning)?

El Aprendizaje Anidado (NL) es un nuevo paradigma que representa coherentemente un modelo como un conjunto de problemas de optimización anidados, de múltiples niveles y/o paralelos, cada uno con su propio «flujo de contexto».

NL revela que los métodos de deep learning existentes aprenden de los datos comprimiendo su propio flujo de contexto. Además, explica cómo emerge el aprendizaje en contexto (in-context learning) en los modelos grandes. NL sugiere una nueva dimensión para el deep learning, permitiendo el diseño de algoritmos de aprendizaje más expresivos con más «niveles,» lo que resulta en habilidades de aprendizaje en contexto de orden superior.

NL y la Jerarquía de Optimización

El NL se inspira en la jerarquía de las ondas cerebrales, que indica la tasa de frecuencia de procesamiento de información de cada parte del cerebro. Para ordenar los componentes, NL utiliza la tasa de frecuencia de actualización de cada problema de optimización.

- Los componentes se clasifican en «niveles» ordenados, donde cuanto más alto es el nivel, menor es su frecuencia de actualización.

- Un ejemplo sencillo demuestra que entrenar un Perceptrón Multicapa (MLP) de una capa con descenso de gradiente y momento (gradient descent with momentum) es, de hecho, un proceso de optimización de dos niveles. El nivel interno aprende a almacenar los valores de gradiente, y el nivel externo actualiza el «peso lento».

Los Optimizadores como Módulos de Aprendizaje Profundo

Una contribución central de NL es la visión de que los optimizadores basados en gradientes, como Adam o SGD con Momentum, son en realidad módulos de memoria asociativa que buscan comprimir los gradientes utilizando el descenso de gradiente.

Esta perspectiva permite el diseño de optimizadores más expresivos (Deep Optimizers) que incorporen:

- Asociación Más Expresiva: Al formular el término de momento como una memoria asociativa que mapea gradientes a valores, el preacondicionamiento puede interpretarse como una manera de dotar al momento de una capacidad de mapeo más significativa.

- Memoria Más Expresiva (Deep Memory): El momento puede verse como un módulo de meta-memoria que utiliza una capa lineal para comprimir gradientes pasados. Para aumentar la capacidad de aprendizaje de este módulo, se puede reemplazar esta memoria lineal con un MLP, resultando en un Descenso de Gradiente con Momento Profundo (Deep Momentum Gradient Descent – DMGD).

HOPE: El Módulo de Aprendizaje Autoreferencial con Memoria Continua

Basándose en los conocimientos de NL sobre los algoritmos de aprendizaje, se presenta la arquitectura HOPE (por sus siglas en inglés, Self-Referential Learning Module with Continuum Memory).

HOPE incorpora dos componentes clave:

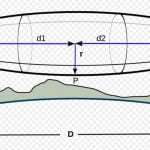

- Continuum Memory System (CMS): Este sistema amplía la visión tradicional de la memoria a largo y corto plazo. CMS se formaliza como una cadena de bloques MLP ($MLP(f1), . . . , MLP(fk)$). Cada bloque MLP está asociado con una frecuencia de actualización distinta ($f\ell$), y sus parámetros se actualizan cada cierto número de pasos ($C(\ell)$). Esto significa que los parámetros de cada capa MLP son responsables de comprimir su propio contexto en su respectiva representación, actuando como conocimiento abstracto de ese contexto específico.

- Módulo de Secuencia Autoreferencial (Self-Modifying Titans): HOPE utiliza un modelo de secuencia autoreferencial que aprende a modificarse a sí mismo al aprender su propio algoritmo de actualización.

Resultados Prometedores

HOPE ha demostrado un muy buen desempeño en tareas de modelado de lenguaje y razonamiento de sentido común. Supera a arquitecturas modernas como Transformers y redes neuronales recurrentes recientes, incluyendo Gated DeltaNet y Titans.

Por ejemplo, al comparar modelos con 1.3B de parámetros y 100B de tokens, HOPE logró un perplexity (ppl) y una precisión superior en varias tareas (benchmarks como PIQA, HellaSwag, WinoGrande, ARC, SIQA y BoolQ) en comparación con sus pares. Específicamente, el dinamismo en el cambio de las proyecciones de clave, valor y consulta, junto con el módulo de memoria profunda de HOPE, contribuyen a una menor perplexity y una mayor precisión en los resultados.

HOPE muestra resultados prometedores en tareas de modelado de lenguaje, aprendizaje continuo y razonamiento de contexto largo.

Fuente: https://openreview.net/forum?id=nbMeRvNb7A